Ya lo han conseguido nuestros queridos burócratas europeos.

Este miércoles, 13 de marzo de 2024 ha sido su gran día. Se ha aprobado la 'Ley de Inteligencia Artificial' en el Parlamento Europeo. La estación final de un camino que comenzó el 21 de abril de 2021 cuando anunciaron "el advenimiento de una tecnología ética en todo el mundo". Así de simple, así de trágico, una ley y todo arreglado.

Si analizamos los documentos de trabajo sobre cómo se regula la IA, observamos que lo que en 2021 se definió como "Sistema de Inteligencia Artificial", esto es, "un software que se desarrolla empleando una o varias de las técnicas y estrategias que figuran en el anexo I y que puede, para un conjunto determinado de objetivos definidos por seres humanos, generar información de salida como contenidos, predicciones, recomendaciones o decisiones que influyan en los entornos con los que interactúa", en 2024 será "un sistema basado en una máquina diseñada para funcionar con distintos niveles de autonomía, que puede mostrar capacidad de adaptación tras el despliegue y que, para objetivos explícitos o implícitos, infiere de la información de entrada que recibe la manera de generar información de salida, como predicciones, contenidos, recomendaciones o decisiones, que puede influir en entornos físicos o virtuales".

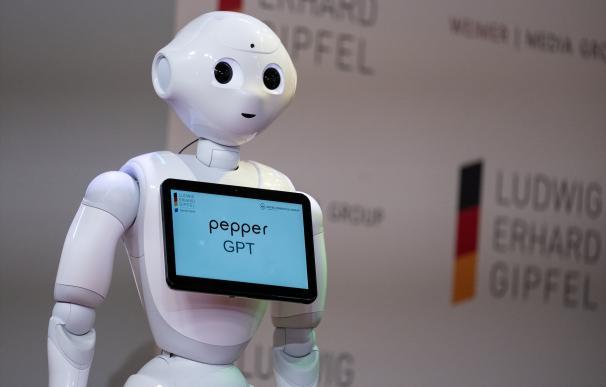

Este cambio en definir qué es lo que quieres regular, junto con la irrupción el 30 noviembre de 2022 de 'ChatGPT' por OpenAI, nos muestran indicios sobre lo que finalmente será la intención de las instituciones que conforman la Unión Europea: volver a perpetrar la imposible tarea de organizar la sociedad en base a mandatos y reglamentos coactivos, ignorando que el orden espontáneo del mercado, que resuelve cada día, en un entorno de continuo cambio, creatividad y coordinación, mediante la función empresarial, cualquier dificultad que pueda representar para el ser humano la llegada de una innovación. ¿Una ley para una tecnología? ¿Cuando venga otra tecnología, otra ley?

Un aspecto fundamental de mi pensamiento libertario es el énfasis en la libertad individual y la preocupación por la asfixiante regulación gubernamental, que potencialmente limita la innovación y la autonomía personal. La ley establece una serie de prácticas de IA prohibidas que, aunque teóricamente buscan proteger a los ciudadanos de abusos potenciales, también podrían interpretarse como limitaciones significativas a la libertad de expresión y a la innovación tecnológica. La libertad otra vez cercenada.

Por ejemplo, se prohíbe el uso de sistemas de IA que utilicen técnicas subliminales o manipuladoras para alterar el comportamiento de una persona de manera que perjudique considerablemente a esa persona o a un grupo de personas. Aunque entiendo la necesidad de evitar el daño, me preocupa que tales prohibiciones sean subjetivas y puedan usarse para restringir injustamente la innovación en el campo de la IA que podría beneficiar a la sociedad de maneras aún no imaginadas.

Además, la ley prohíbe específicamente la creación de bases de datos de reconocimiento facial mediante la extracción no selectiva de imágenes de internet o circuitos cerrados de televisión, así como el uso de sistemas de IA para inferir emociones en contextos laborales y educativos, excepto por razones médicas o de seguridad. Si bien la privacidad y la protección contra la vigilancia invasiva son cruciales, las regulaciones estrictas en estas áreas pueden frenar el desarrollo de tecnologías que podrían tener aplicaciones legítimas y valiosas, restringiendo así el potencial de mercado y la competencia.

La ley también prohíbe los sistemas de IA que clasifican a las personas en base a datos biométricos para inferir rasgos como raza, opiniones políticas, o orientación sexual. Aunque esto busca prevenir discriminación y abusos, desde una perspectiva libertaria, la regulación plantea preguntas sobre la medida en que el estado debe intervenir en el desarrollo tecnológico y en qué punto la protección se convierte en un impedimento para la exploración científica libre y el progreso tecnológico.

La solidez y la precisión de la IA se garantizarán por aquellos que las desarrollen, no con copias de seguridad o planes de prevención contra fallos como se establece en el Reglamento que se aprobará, sino bajo efectivos sistemas de resolución de conflictos en los que se apliquen leyes que protejan la libertad y la propiedad de los ciudadanos, en los que se puede imputar las responsabilidades a las personas físicas y jurídicas que sean los titulares de esos sistemas de IA, aunque los resultados del uso de esos sistemas no provengan de específicas instrucciones creadas por un humano. ¿Saben que no hay casi ninguna empresa europea que se regulará con esta ley? Se preguntará por qué. Porque no existen gigantes de la IA en Europa. Las empresas que regularán esta ley serán en su mayoría americanas. Pregúntese por qué no los tenemos.

En definitiva, como promulgó la Constitución de 1812 en su Artículo 4, la Unión Europea "está obligada a conservar y proteger por leyes sabias y justas la libertad civil, la propiedad, y los demás derechos legítimos de todos los individuos que la componen", y este Reglamento no ayudará a crear un ámbito regulatorio que fomente la innovación, continuando una línea intervencionista que provocará la huida la inversión tecnología.